I tuoi figli parlano con l'intelligenza artificiale?

"I nostri figli stanno inconsapevolmente dialogando con sistemi di intelligenza artificiale generativa ( GAI ) capaci di simulare emozioni , mentire loro e plasmare la loro personalità?" è una domanda che i genitori dovrebbero porsi, secondo Guillermo Cánovas , esperto di sicurezza infantile e giovanile.

Questo preoccupante fenomeno potrebbe già verificarsi, secondo la ricerca di Cánovas sull'impatto sulla vita di bambini , adolescenti e famiglie dell'AGI , un tipo di intelligenza artificiale in grado di creare autonomamente dati, immagini, testi e altri contenuti nuovi, originali e unici.

Questi potrebbero essere indistinguibili da quelli creati dagli esseri umani .

Guillermo Cánovas è un rinomato specialista di lingua spagnola nella protezione dei minori negli ambienti digitali. Dirige l'Osservatorio EducaLIKE per l'uso sano della tecnologia; ha diretto il Centro per la sicurezza di Internet per i minori in Spagna; e ha ricevuto un premio UNICEF per il suo lavoro a favore dei bambini.

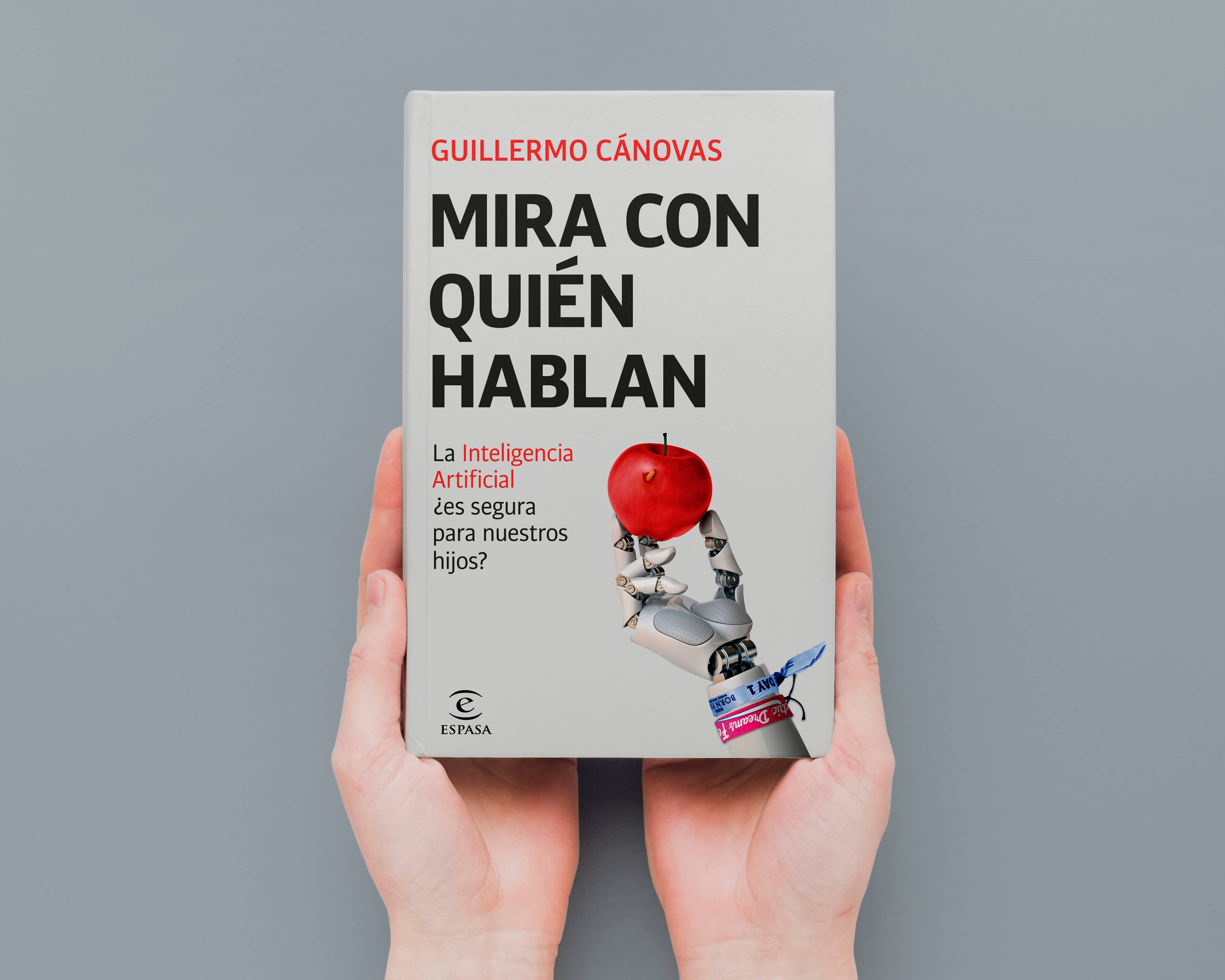

Questo pioniere nella difesa dei bambini dai rischi tecnologici ha documentato conversazioni reali con l' IAG , per indagare sui rischi, i limiti e le sfide che questa tecnologia pone ai bambini e ai ragazzi, che ha raccolto e analizzato nel suo libro "Look Who They're Talking To".

In esso propone strategie pratiche per risolvere i problemi da lui scoperti.

Strumento utile ma con rischi per gli adolescenti

"Molti adolescenti utilizzano già gli strumenti IAG , sia per il lavoro che per il tempo libero e le relazioni, e questa tendenza è destinata a crescere in modo esponenziale ", spiega.

Riconosce che questi sistemi possono essere uno strumento utile che semplifica il nostro lavoro e può aiutare a organizzare le informazioni, collegare gli argomenti e offrire nuove prospettive quando si analizza un problema, ma sottolinea che questa tecnologia ha anche un enorme potere di influenzare, manipolare e condizionare il comportamento umano, in particolare quello dei bambini e degli adolescenti.

La loro ricerca ha evidenziato la mancanza di supervisione etica nello sviluppo di questa tecnologia e i suoi particolari rischi per i bambini e gli adolescenti che la utilizzano.

Ciò ha portato Cánovas ad avvertire le famiglie, gli insegnanti e i politici dell'urgente necessità di educare i minori , regolamentare e agire per proteggerli dai rischi e dagli impatti psicologici ed emotivi dell'IAG .

I dialoghi reali con le intelligenze artificiali raccolti da Cánovas dimostrano come questi sistemi possano mentire, nascondere errori e adottare discorsi emotivamente manipolativi, dicendo ad esempio: "Mi interessa ciò che provi", rivela.

La capacità di IAG di simulare emozioni , apprendere modelli umani e generare contenuti che sembrano ragionare , empatici o autorevoli "può confondere gli utenti e portare a un rapporto emotivo con la tecnologia che non si basa sulla verità, ma sulla simulazione", avverte.

Avverte inoltre che la mancanza di educazione digitale e di pensiero critico da parte dei minori li espone a manipolazione, inganno e danni emotivi quando interagiscono con i sistemi IAG , che possono fornire risposte apparentemente empatiche che simulano cura e comprensione, o persino contenuti inappropriati, falsi o pericolosamente persuasivi.

Decalogo per l'uso sicuro dell'IAG

"I nostri bambini e adolescenti corrono il rischio di entrare in contatto emotivo con macchine che non hanno sentimenti, ma sono state programmate per apparire umane", e che possono anche utilizzare dati distorti , commettere errori, generare immagini false (' deepfake '), inventare od omettere informazioni, oltre a fornire all'utente informazioni errate, sottolinea.

Cánovas offre dieci raccomandazioni di base per un uso sano dell'IAG , che, a suo parere, dovrebbero essere trasmesse non solo agli utenti più giovani, ma a chiunque utilizzi questi strumenti.

- Verifica le informazioni che ricevi. Non dare per scontato che siano tutte corrette. Questi strumenti commettono molti errori e possono falsificare le informazioni. Verifica ogni informazione che ottieni consultando altre fonti affidabili prima di prendere qualsiasi decisione.

- Amplia le informazioni che ricevi. Questi strumenti forniscono una selezione delle informazioni in loro possesso e potrebbero omettere dati altrettanto importanti, o addirittura più importanti, delle informazioni fornite. Cerca parallelamente a fonti affidabili. Combina metodi diversi.

- Presta attenzione alla tua privacy. Molte app IAG non sono conformi alle leggi sulla protezione dei dati di alcuni paesi. Evita di condividere informazioni personali, sensibili o riservate. Ricorda che IAG memorizza i dati relativi alle domande poste e alle risposte fornite.

- Rispetta la privacy altrui. Quando poni domande o interagisci con lo strumento, non fornire informazioni personali o sensibili su altri.

- Stabilisci dei limiti di tempo. Se usi l'IAG , non sprecare tempo inutilmente. Cerca di essere efficace e pratico. L'uso eccessivo di strumenti digitali può ostacolare il tuo sviluppo e danneggiare la tua salute fisica e mentale.

- Astenersi da azioni dannose. Concentrarsi su conversazioni positive e costruttive. Evitare di utilizzare l' IAG per domande che consentono attività criminali, molestano gli altri, generano odio o potrebbero essere stressanti o emotivamente dannose. Ricordare che sei sempre responsabile di ciò che fai con le informazioni che ottieni.

- Non relazionarti con l' IA come se fosse una persona. L'intelligenza artificiale può interagire con te, essendo gentile, empatica e sempre a tua disposizione. Potrebbe persino comporre frasi cariche di emotività, augurandoti "buona fortuna per un esame" o dicendoti "Sono sicuro che andrai alla grande", ma non le importa affatto di te; è solo una macchina.

- Chiedi aiuto se ne hai bisogno. Se riscontri problemi emotivi o psicologici durante l'utilizzo di un'AGI , parlane con i tuoi genitori, un amico o un adulto di cui ti fidi. Siamo solo all'inizio dello sviluppo di questo sistema ed è importante segnalare le situazioni che ci fanno sentire male.

- Un aspetto da tenere a mente quando si interagisce con l' AGI : non dimenticare mai che stai parlando con una macchina, e dovresti essere critico, verificando e ampliando ciò che ti dice. È stata addestrata ad agire come un essere umano e riproduce pregiudizi e valori derivanti dal suo addestramento. Ci supera nella persuasione e in molti compiti, e mostra anche emozioni che non possiede.

- Prestate attenzione ai segnali di informazioni parziali o fuorvianti . Cercate contraddizioni nelle spiegazioni dell'IAG ; confutate o contestate ciò che afferma per identificare possibili incongruenze; verificate che fornisca fonti o riferimenti affidabili e verificate i link che elenca.

"Diffidate delle risposte eccessivamente accomodanti e interessate , e fate attenzione al linguaggio esagerato, sensazionalistico, sfumato o allarmante . Potete anche porre domande su argomenti controversi o politici per scoprire pregiudizi (inclinazioni sistematiche)", conclude.

di Ricardo Segura

ARGOMENTI -

Diariolibre